Хакери вече използват AI в кибератаките

Google предупреждава, че хакери вече използват изкуствен интелект в реални кибератаки, автоматизирайки откриването на уязвимости и създаването на зловреден софтуер.

Google отправи сериозно предупреждение: хакерите вече използват изкуствен интелект в реалните си кибератаки.

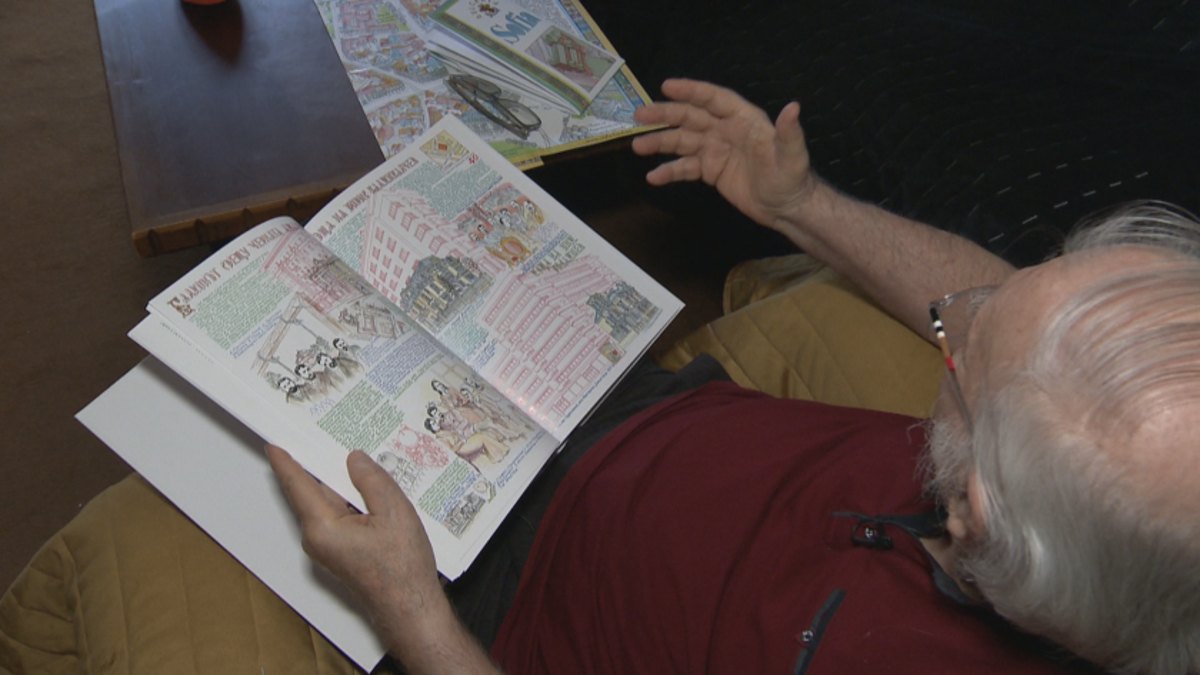

Екипите за киберсигурност на Google TIG разкриха, че са предотвратили хакерска атака, която успешно е използвала голям езиков модел (LLM), за да открие и използва „нулев ден“ уязвимост – неизвестен досега софтурен недостатък, в популярен онлайн инструмент за системна администрация, съобщава в.

The New York Times.

В продължение на години, хакерството на високо ниво изискваше големи технически познания, търпение и ръчен труд.

Нападателите често се нуждаеха от екипи от квалифицирани специалисти, за да открият уязвимости и да напишат зловреден код.

Изкуственият интелект променя това уравнение бързо, като автоматизира много части от хакерския процес.

Съвременните системи с изкуствен интелект вече могат да анализират код, да идентифицират слаби места, да генерират фишинг имейли, да пишат скриптове за зловреден софтуер и да адаптират атаки в реално време.

Изследователи на Google предупреждават, че киберпрестъпниците и подкрепяните от държави хакерски групи, все по-често експериментират с кибероперации с изкуствен интелект.

Докато откриването на уязвимост някога е било труден и отнемащ време подвиг за човешките експерти, моделите с изкуствен интелект сега могат да сканират трилиони редове код, за да идентифицират логически недостатъци с огромен капацитет.

При осуетената атака хакерите са използвали изкуствен интелект, за да открият семантичен логически недостатък на високо ниво, който да им позволи да заобиколят двуфакторното удостоверяване (2FA).

Експертите отбелязват, че хакерите преминават от използване на изкуствен интелект като експеримент към използване като норма, мащабирайки атаките от анализ на целта до генериране на зловреден софтуер.

Клонирането на глас и вишингът (гласов фишинг) улесняват нападателите да се представят за ръководители или ИТ персонал, за да откраднат идентификационни данни.

Експертите са загрижени за агентите с изкуствен интелект - автономни системи, способни да изпълняват многоетапни задачи с минимален човешки надзор.

В киберсигурността агентите с изкуствен интелект биха могли в крайна сметка да сканират мрежи, да идентифицират слабости, да стартират атаки и да коригират тактиките автоматично.

Някои академични изследователи предупреждават, че агентите с изкуствен интелект могат фундаментално да променят баланса между нападателите и защитниците, защото кибератаките биха могли да станат масово мащабируеми и много по-евтини за изпълнение.

Това обаче не означава, че обикновените потребители са безпомощни.

Всъщност много традиционни навици за киберсигурност стават още по-важни в ерата на изкуствения интелект.

Една от най-важните защити е актуализирането на софтуера.

Хакерите все по-често се насочват към неотстранени уязвимости, защото автоматизираните инструменти могат бързо да сканират милиони системи.

Инсталирането на актуализации на операционната система, браузъра и приложенията навреме остава една от най-простите и ефективни защити.

Силните пароли също са по-важни от всякога.

Експертите препоръчват използването на уникални пароли за всеки акаунт, заедно с мениджъри на пароли, които могат да генерират и съхрават сложни идентификационни данни.

Многофакторното удостоверяване трябва да се активира, когато е възможно, въпреки че някои нападатели се опитват да го заобиколят.

В повечето случаи многофакторното удостоверяване все още драстично намалява риска.

Потребителите трябва да станат по-предпазливи и по отношение на опитите за фишинг.

Генерираните от изкуствен интелект фишинг имейли, фалшиви уебсайтове и измамни телефонни обаждания стават далеч по-убедителни от по-старите спам кампании.

Престъпниците вече могат да използват изкуствен интелект, да имитират стилове на писане, да клонират гласове и да персонализират измами, използвайки публично достъпна информация от социалните медии.

Подозрителните линкове, неочакваните прикачени файлове и спешните финансови искания винаги трябва да бъдат проверявани, преди да се кликне върху тях или да се отговори.

Друг нарастващ проблем са генерираните от изкуствен интелект фалшиви клипове (deepfake).

Киберпрестъпниците започват да използват фалшиви аудио и видео клипове, за да се представят за ръководители, членове на семейството или колеги.

Някои компании вече изискват вербални кодови фрази или вторични стъпки за проверка, преди да одобрят чувствителни финансови транзакции.

Самата индустрия за киберсигурност се надпреварва да се бори с изкуствения интелект с помощта на изкуствен интелект.

Google, Microsoft и други големи фирми изграждат защитни системи, способни да идентифицират подозрително поведение, да откриват автоматично уязвимости и да реагират на атаки по-бързо, отколкото хората биха могли да се справят сами.

Въпреки това експертите смятат, че обществото навлиза в труден преходен период.

Изкуственият интелект прави едновременно защитата и нападението по-мощни.

Предизвикателството е, че нападателите често се движат по-бързо, защото им е необходимо само едно успешно нарушение, докато защитниците трябва да защитават всичко непрекъснато.

Коментари (0)